Horrorszenario: KI-generierte Röntgenbilder

Heutige KI-Systeme können problemlos auf eine einfache Spracheingabe hin anatomisch plausible, fotorealistische Röntgenbilder erzeugen. Diese Möglichkeit wird heute bereits genutzt, um beispielsweise in der Ausbildung seltene Pathologien zu synthetisieren oder die Positionierung und Belichtung von Bildern systematisch zu variieren.

Fake-Röntgenbilder in elektronischen Patientenakten?

Neben solchen produktiven Einsatzzwecken können die KI-Fähigkeiten aber auch massiv missbraucht werden. „Bösartige synthetische Röntgenbilder könnten in Forschungsdatensätze eindringen, das Training von KI-Modellen durch Datenmanipulation verfälschen oder sogar in individuelle elektronische Patientenakten eingeschleust werden. Dies erhöht das Potenzial für Diagnosefehler und Rechtsstreitigkeiten“, schreiben die Studienautoren. Daneben betonen sie, dass sich hochaufgelöste Deep-Fake-Bilder mittlerweile „auch der Medizin zu einem Sicherheits- und Vertrauensproblem“ entwickeln.

Große Probleme mit der Erkennung der Fake-Bilder

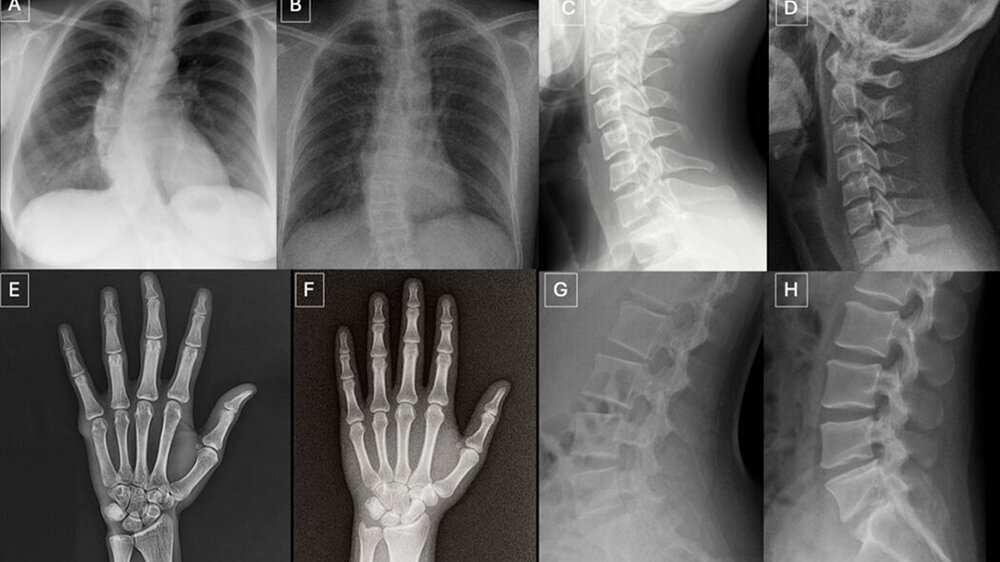

Ziel der Arbeitsgruppe war daher herauszufinden, inwieweit Radiologen und Künstliche Intelligenz in der Lage sind, von ChatGPT generierte synthetische Röntgenbilder von authentischen Bildern zu unterscheiden. Dazu sollten 17 Radiologen aus sechs Ländern mit unterschiedlicher Berufserfahrung Bilder beurteilen. Wie sich zeigte spielte die Information darüber, dass unter den präsentierten Röntgenbildern synthetisch erzeugte waren, eine große Rolle.

Zunächst wurden die Probanden nicht über den Studienzweck aufgeklärt und ihnen wurden 154 Röntgenaufnahmen verschiedener anatomischer Regionen (77 synthetische Bilder, generiert mit ChatGPT [GPT-4o; OpenAI], und 77 authentische Bilder) gezeigt. Nur sieben der 17 verblindeten Radiologen erkannten spontan die KI-generierten Bilder. Nachdem der Studienzweck bekannt war, glättete sich die Performance der Teilnehmer: Sie erreichten sie eine mittlere Genauigkeit von 74,8 Prozent (95 %-KI: 68,4–81,2) bei der Unterscheidung zwischen KI-generierten und realen Röntgenbildern. Die individuelle Genauigkeit lag zwischen 58,4 Prozent und 91,6 Prozent.

Es zeigte sich kein linearer Zusammenhang zwischen der Berufserfahrung und der Genauigkeit der Befunder bei der Unterscheidung zwischen synthetischen und realen Röntgenbildern.

GPT-4o erkennt seinen eigenen Fake nicht zuverlässig

Auch die KI selbst hatte große Probleme bei der Unterscheidung zwischen KI-generierten und realen Bildern. Obwohl die synthetischen Bilder mit GPT-4o erstellt wurden, identifizierte das KI-Modell den eigenen Fake nicht sicher. Gleichwohl zeigte GPT-4o mit einer Genauigkeit von 85 Prozent die höchste Trefferquote, gefolgt von GPT-5 (83 Prozent), Llama 4 Maverick (59 Prozent) und Gemini 2.5Pro (56 Prozent).

Missbrauchspotenzial muss eingedämmt werden

Die Ergebnisse zeigen den Studienautoren zufolge ein erhebliches Missbrauchspotenzial. Dem müsse „mehrstufig“ mit verschiedenen Maßnahmen entgegengetreten werden. Als mögliche Maßnahmen schlagen sie die Schulung von Ärzten, den Einsatz automatisierter Deepfake-Erkennungssysteme, obligatorischer Wasserzeichen in Röntgenbildern und eine „strenge Datenverwaltung“ vor. Das sei „unerlässlich, um zu verhindern, dass sich diese neue Technologie zu einer systemischen Bedrohung entwickelt“.

Die Studie ist Open Access veröffentlicht.